À Argonne, des chercheurs utilisent des supercalculateurs pour simuler la turbulence dans les réacteurs et les enceintes de confinement : un virage qui peut renforcer la sûreté nucléaire et accélérer l’arrivée de nouveaux designs bas carbone.

La turbulence, c’est le tourbillon du café et les secousses d’une aile d’avion. Dans une centrale, c’est beaucoup plus : elle gouverne le transfert de chaleur et la façon dont les gaz se mélangent. Et dans un accident rare, ce mélange peut décider si une enceinte tient ou cède. Argonne affirme avoir remplacé des approximations par du calcul brut, validé à l’aveugle sur un test international.

La turbulence, ce détail qui peut faire basculer la sûreté

Dans un réacteur, les fluides ne se contentent pas de “circuler”. Ils tourbillonnent, se déchirent, s’entremêlent à toutes les échelles. C’est précisément cette turbulence qui commande deux choses vitales : le transfert thermique et le mélange de gaz. Le problème, c’est que les modèles historiques “lissent” souvent ce chaos pour tenir dans un temps de calcul raisonnable. Résultat : ils peuvent rater des tourbillons minuscules mais décisifs, ceux qui changent localement la température ou la concentration d’un gaz. Dans l’industrie nucléaire, le diable est rarement dans le scénario “normal”. Il se cache dans les événements rares, difficiles à tester, mais qui doivent être compris. C’est là que la simulation haute fidélité devient une arme, à condition d’être crédible.

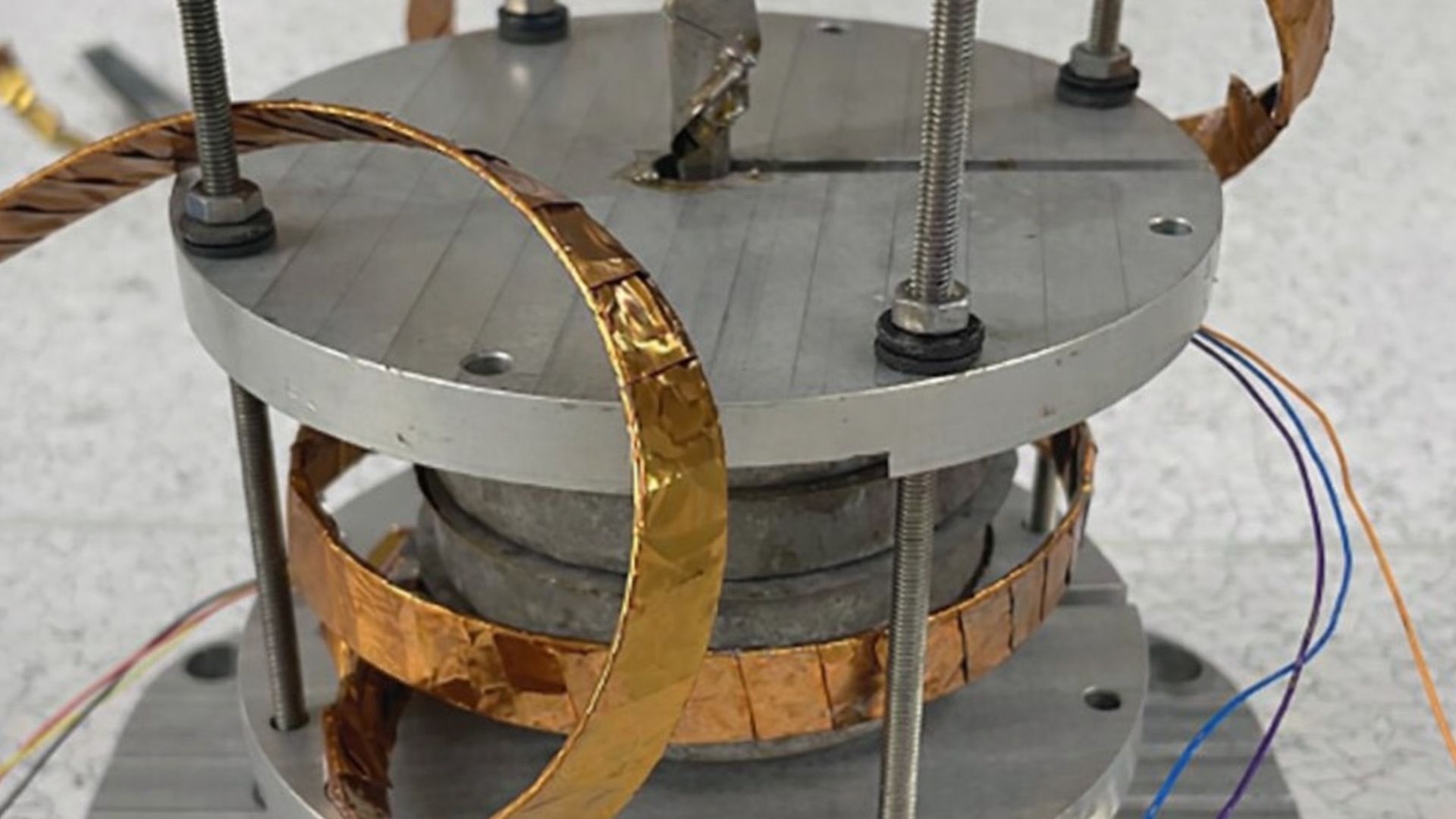

Après Fukushima, l’hydrogène est devenu une obsession technique

Depuis l’accident de Fukushima en 2011, un sujet revient comme un boomerang : le comportement de l’hydrogène dans les enceintes de confinement. En situation dégradée, l’hydrogène peut se mélanger à l’air, s’accumuler, et créer un risque d’explosion. Pour les ingénieurs, la question n’est pas “est-ce possible ?” mais “où, quand, et à quel niveau de concentration ?”. Argonne a adapté ses outils pour prédire précisément ces mélanges dans des géométries complexes, là où des approches plus simples peuvent échouer. C’est un changement de logique : on ne cherche plus seulement une estimation “moyenne”, on cherche une carte de risques spatiale et temporelle.

Pourquoi la France a intérêt à suivre ce dossier

Pour la France, le sujet n’est pas théorique : entre la relance du nucléaire et les projets EPR2, tout ce qui améliore la sûreté et la capacité à qualifier des scénarios rares devient stratégique. Des simulations haute fidélité du mélange d’hydrogène ou du transfert de chaleur peuvent aider des acteurs comme EDF, le CEA ou Framatome à réduire les zones d’incertitude, à mieux cibler les essais physiques et à accélérer les cycles de conception. Côté encadrement, des outils validés par des tests à l’aveugle peuvent aussi intéresser l’écosystème de contrôle (ASN), parce qu’ils rendent les démonstrations plus auditables et reproductibles.

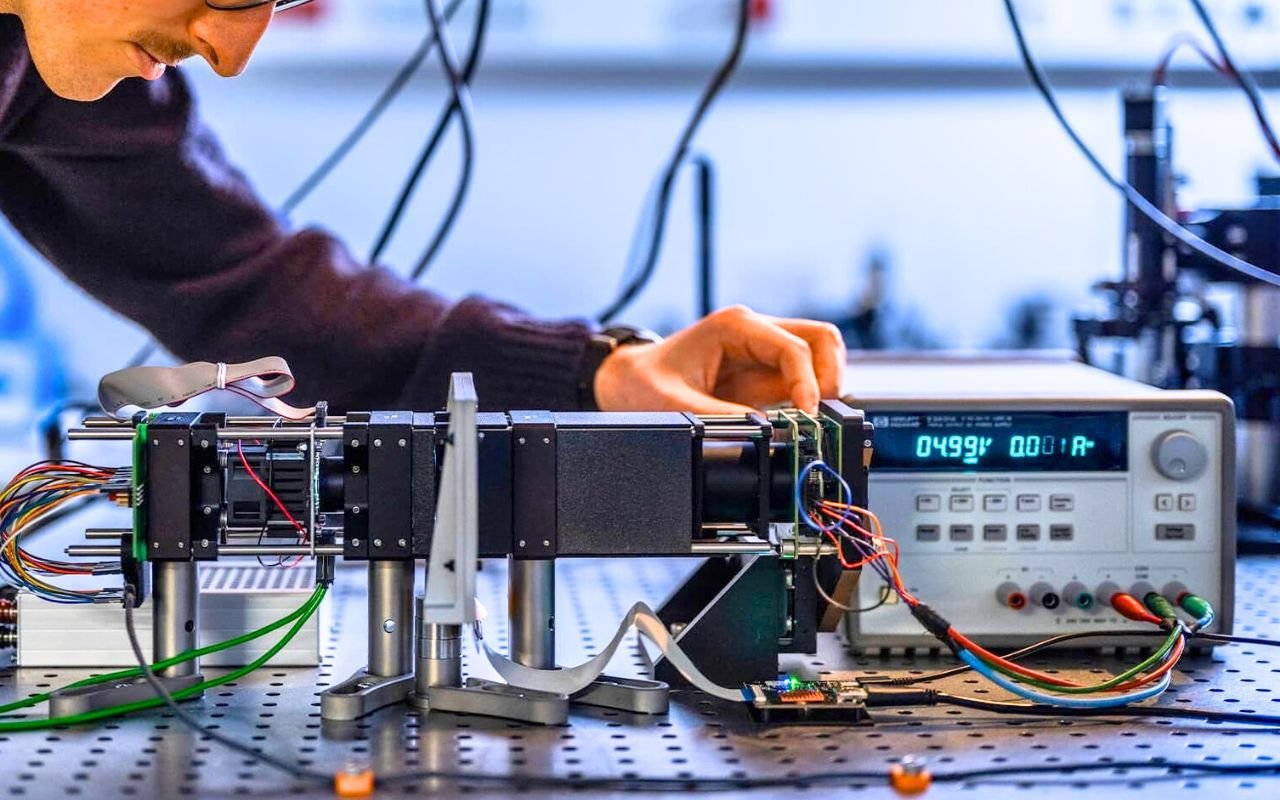

Deux codes open source, deux philosophies : Nek5000 et NekRS

Le cœur technique tient en deux logiciels de mécanique des fluides numériques, tous deux open source : Nek5000 et NekRS. Le premier est plutôt orienté CPU. Le second est conçu pour profiter des GPU, ces processeurs massivement parallèles qui avalent des calculs répétitifs à grande vitesse. Pourquoi ce détail compte ? Parce qu’une simulation haute fidélité peut demander des semaines de calcul. Si vous réduisez ces semaines à quelques jours, vous changez la pratique : vous testez plus de configurations, vous explorez plus de scénarios, et vous itérez beaucoup plus vite. Pour la sûreté, le temps n’est pas un confort. C’est la différence entre un modèle théorique et un outil réellement utilisable.

Le test “à l’aveugle” PANDA : la crédibilité, sinon rien

On ne confie pas la sûreté à une simulation parce qu’elle “a l’air plausible”. On la confie parce qu’elle a passé un examen sans triche. Argonne cite un banc d’essai international, PANDA, conçu comme un benchmark à l’aveugle : on donne la forme d’un réservoir et des conditions initiales, mais pas les résultats expérimentaux. Les équipes doivent prédire l’écoulement avant de voir la réponse. Selon Argonne, leurs modèles ont anticipé correctement les résultats. C’est un point crucial : un succès en “blind benchmark” est un argument de confiance et de validation. Sans cela, la simulation reste une belle animation.

Le régulateur s’y intéresse : quand la NRC veut des outils fiables

Le fait marquant, c’est l’attention d’un acteur clé : la NRC (le régulateur nucléaire américain). Les régulateurs ont un besoin concret : évaluer des scénarios rares, souvent impossibles à tester à grande échelle, dans des géométries d’enceintes réelles. Or, ce sont précisément ces géométries qui mettent en défaut des outils trop simplifiés. Dans cette collaboration, l’enjeu n’est pas d’avoir “plus de calcul”. L’enjeu est d’avoir un outil que l’on peut auditer, comprendre, et reproduire. Autrement dit, un outil qui peut entrer dans une décision réglementaire. Cette bascule change le statut du calcul : de la recherche vers l’expertise.

Aurora et les GPU : passer de semaines à jours

La suite du programme se joue sur Aurora, l’un des supercalculateurs les plus puissants construits à ce jour. L’idée est simple : basculer des simulations lourdes d’une approche centrée CPU vers une approche centrée GPU, pour gagner un facteur de vitesse et ouvrir des simulations plus complexes. Cela permet aussi de mieux couvrir les “coins” de la physique : plus de détails, plus de maillage, plus de phénomènes couplés. Et surtout, plus de répétitions. En sûreté, un scénario unique ne suffit pas. Ce qu’on veut, c’est une enveloppe : des milliers de variations pour cerner les conditions d’échec.

Des jumeaux numériques pour gagner du temps et de l’argent

Derrière la sûreté, il y a une réalité industrielle : les expériences physiques à grande échelle coûtent cher et prennent du temps. Les simulations haute fidélité peuvent remplacer une partie de ces essais par des jumeaux numériques qui explorent des paramètres, trient les hypothèses, et réduisent le nombre de tests indispensables. C’est aussi un accélérateur pour les réacteurs de nouvelle génération : si vous pouvez démontrer des comportements avec des preuves numériques solides, vous pouvez raccourcir certains cycles de conception. Argonne s’inscrit dans un programme du DOE, NEAMS, et évoque une intégration future de IA et d’apprentissage machine pour améliorer la vitesse et la capacité prédictive.

| Brique | À quoi ça sert | Effet concret |

| Nek5000 | simulations CFD sur CPU | précision, base éprouvée |

| NekRS | simulations CFD sur GPU | mêmes idées, plus vite |

| PANDA | benchmark à l’aveugle | validation et confiance |

| Aurora | supercalcul GPU massif | passer de semaines à jours |

Source : Nature Communications