Avec Vera, Nvidia ne se contente plus d’accompagner l’explosion de l’IA avec ses GPU : le groupe veut désormais prendre une place centrale dans le marché des processeurs pour serveurs, avec une puce 88 cœurs et des racks géants pensés pour avaler les charges de calcul modernes.

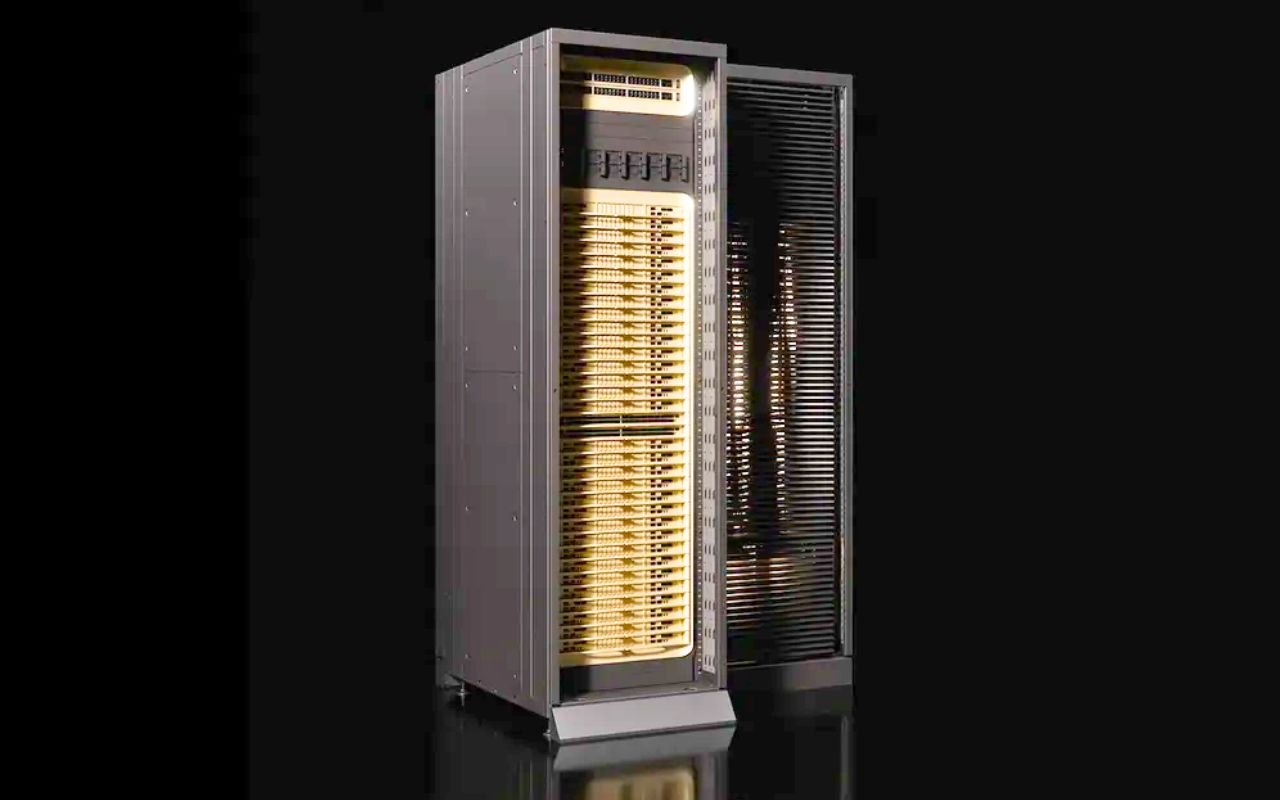

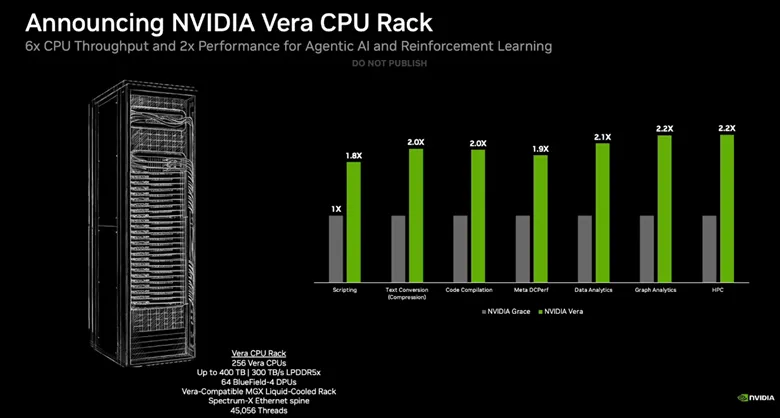

À la GTC 2026, Nvidia a cessé de jouer les figurants sur le terrain du CPU. L’entreprise a détaillé Vera, sa nouvelle puce pour centres de données, et surtout une architecture de rack qui donne le ton : 256 processeurs refroidis par liquide dans une seule baie. Derrière l’effet vitrine, le message est simple. Nvidia veut concurrencer Intel et AMD là où se décide désormais la bataille industrielle : les serveurs pour l’IA, les bases de données, le code et l’infrastructure cloud.

Nvidia ne veut plus dépendre des autres

Pendant des années, Nvidia a bâti sa domination sur les GPU. Mais dans les centres de données modernes, le processeur reste un maillon décisif. Il alimente les tâches qui entourent l’IA : exécution de scripts, requêtes SQL, compilation de code, orchestration logicielle. Avec Vera, Nvidia entre donc plus frontalement dans le marché du CPU serveur. Ce n’est plus un simple composant d’accompagnement pour ses accélérateurs maison : c’est un produit stratégique, conçu pour être vendu seul, intégré dans des racks complets et déployé chez les grands acteurs du cloud.

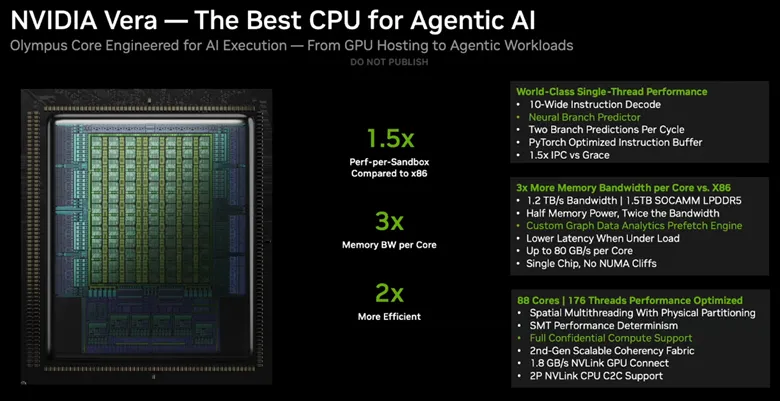

Une puce 88 cœurs pensée pour les charges lourdes

Vera embarque 88 cœurs et 176 threads, contre 72 cœurs pour Grace, la génération précédente. Nvidia promet un gain de 50 % face à des processeurs classiques sur certains usages, mais le chiffre le plus agressif est ailleurs : l’entreprise affirme avoir augmenté de 1,5 fois l’IPC, c’est-à-dire le nombre d’instructions traitées à chaque cycle d’horloge. Dans l’industrie, ce genre de bond est rare. Cela signifie que Nvidia ne s’est pas contenté d’ajouter des cœurs : le groupe cherche aussi à améliorer la performance par cœur, un terrain sur lequel Intel et AMD restent redoutables.

Olympus, le cœur qui doit faire la différence

Le changement majeur vient des nouveaux cœurs Olympus, conçus par Nvidia à partir de l’architecture Arm v9.2-A. La firme insiste sur un point : ces cœurs ont été retravaillés pour mieux gérer les charges réelles des centres de données. Leur spécialité tient à une forme de multithreading spatial qui évite à deux threads de trop se gêner mutuellement. En clair, au lieu de se partager certaines ressources à tour de rôle, ils peuvent utiliser des éléments matériels séparés. Résultat attendu : davantage de débit, plus de prévisibilité, et un meilleur rendement dans les environnements où plusieurs clients ou tâches cohabitent.

La mémoire devient une arme à part entière

Dans les serveurs modernes, la puissance brute ne suffit pas. Encore faut-il nourrir correctement les cœurs. C’est là que Vera tente un vrai coup. Nvidia annonce jusqu’à 1,2 To/s de bande passante mémoire, contre 546 Go/s pour Grace. La capacité grimpe aussi à 1,5 To de mémoire LPDDR5 sur puce, soit trois fois plus qu’avant. Rapporté à chaque cœur, cela change la donne pour les charges gourmandes en données. Nvidia évoque même jusqu’à 80 Go/s pour un seul cœur dans certaines conditions. Pour les tâches d’analyse, d’IA ou de graphes, ce genre de marge peut peser lourd.

Un seul domaine pour éviter les lenteurs inutiles

L’un des arguments les plus techniques, mais aussi les plus intéressants, concerne l’organisation interne de la puce. Nvidia place les 88 cœurs dans un domaine unique, afin d’éviter les complications liées aux architectures NUMA qui affectent souvent les processeurs x86 très denses. Dit plus simplement, l’entreprise veut réduire les détours et les latences quand les cœurs accèdent à la mémoire ou échangent des données. Cette approche vise la latence, la régularité et la simplicité de programmation. C’est moins spectaculaire qu’un chiffre marketing, mais dans un centre de données, cette cohérence compte parfois plus qu’un pic de performance isolé.

Le rack Vera montre la vraie ambition de Nvidia

Le plus révélateur n’est peut-être pas la puce elle-même, mais le système qui l’accompagne. Nvidia a présenté un rack Vera regroupant 256 processeurs refroidis par liquide, associés à 74 DPU BlueField-4 et à une connectivité réseau maison. L’ensemble peut monter à 400 To de mémoire LPDDR5 et à 300 To/s de bande passante agrégée. Nvidia parle d’un gain pouvant atteindre 6 fois le débit CPU sur certains usages par rapport à ses solutions précédentes, et d’un doublement des performances pour des charges d’IA agentique. Là, on ne parle plus d’un simple composant. On parle d’une machine de guerre pour les hyperscalers.

Intel et AMD sont désormais visés sans détour

Le discours de Nvidia est limpide : Vera n’est pas seulement pensé pour compléter un cluster de GPU, mais pour rivaliser avec les offres d’AMD et d’Intel sur les sockets serveur classiques. L’entreprise vise aussi les puces Arm maison utilisées par les géants du cloud. Plusieurs noms ont déjà été cités pour les futurs déploiements ou offres partenaires : Meta, Oracle, CoreWeave, Alibaba, Dell, HPE, Lenovo ou Supermicro. Les premières livraisons sont attendues au second semestre 2026. En clair, Nvidia veut transformer sa domination dans l’IA en domination d’infrastructure. Et si Vera tient ses promesses sur le terrain, la bataille des centres de données pourrait devenir encore plus brutale.

| Élément clé | Ce qu’il faut retenir |

| Nom du processeur | Nvidia Vera |

| Architecture | Arm v9.2-A avec cœurs Olympus |

| Cœurs / threads | 88 cœurs / 176 threads |

| Bande passante mémoire | Jusqu’à 1,2 To/s |

| Mémoire maximale | 1,5 To sur puce |

| Interconnexion | NVLink-C2C jusqu’à 1,8 To/s |

| Rack Vera | 256 CPU refroidis par liquide |

| Gain annoncé | Jusqu’à 6 fois le débit CPU |

| Livraison | Second semestre 2026 |

Source : NVIDIA