Un cap vient d’être franchi dans la simulation classique des circuits quantiques appliqués à la chimie.

Une équipe conjointe du Center for Quantum Information and Quantum Biology de l’Université d’Osaka et de Fixstars Corporation annonce avoir réalisé l’une des plus grandes simulations de circuits de chimie quantique, en mobilisant jusqu’à 1 024 GPU sur une infrastructure de calcul haute performance. Le résultat dépasse une barrière technique souvent citée, celle des 40 qubits pour des simulations de type state-vector dans ce domaine. L’objectif n’est pas de remplacer un ordinateur quantique, mais de tester à grande échelle des algorithmes censés tourner, demain, sur des machines quantiques tolérantes aux fautes. Et si tu te demandes à quoi ça sert concrètement, la réponse tient en deux mots, médicaments et matériaux, avec des calculs aujourd’hui hors de portée.

Osaka et Fixstars dépassent la limite des 40 qubits

Le cur de l’annonce porte sur la simulation de circuits d’IQPE (estimation de phase quantique itérative) adaptés à la chimie quantique. Cette famille de circuits sert notamment à estimer des valeurs propres liées à l’énergie d’un système moléculaire, un point central quand on cherche à prédire des propriétés chimiques. Ici, l’enjeu est de pouvoir valider des approches algorithmiques sur des instances plus réalistes que les démonstrations jouets souvent utilisées en laboratoire. La performance revendiquée tient au franchissement d’un plafond, le fameux seuil des 40 qubits précédemment rapporté pour des simulations state-vector en chimie quantique. Dépasser ce niveau n’est pas un simple +1 qubit symbolique, parce que la mémoire et le temps de calcul explosent avec la taille de l’état. C’est justement pour ça qu’un record de ce type est présenté comme un jalon, utile pour comparer des méthodes et repérer ce qui casse en conditions quasi industrielles. Nuance importante, on parle bien d’une simulation classique, pas d’un calcul exécuté sur un processeur quantique. C’est moins spectaculaire sur le papier, mais c’est souvent plus exploitable à court terme pour les équipes qui développent des algorithmes. Un ingénieur HPC interrogé dans l’écosystème, Marc, spécialiste des clusters, résume le point de friction, le vrai sujet, ce n’est pas de battre un chiffre, c’est de vérifier que les circuits restent stables et mesurables quand on change d’échelle.

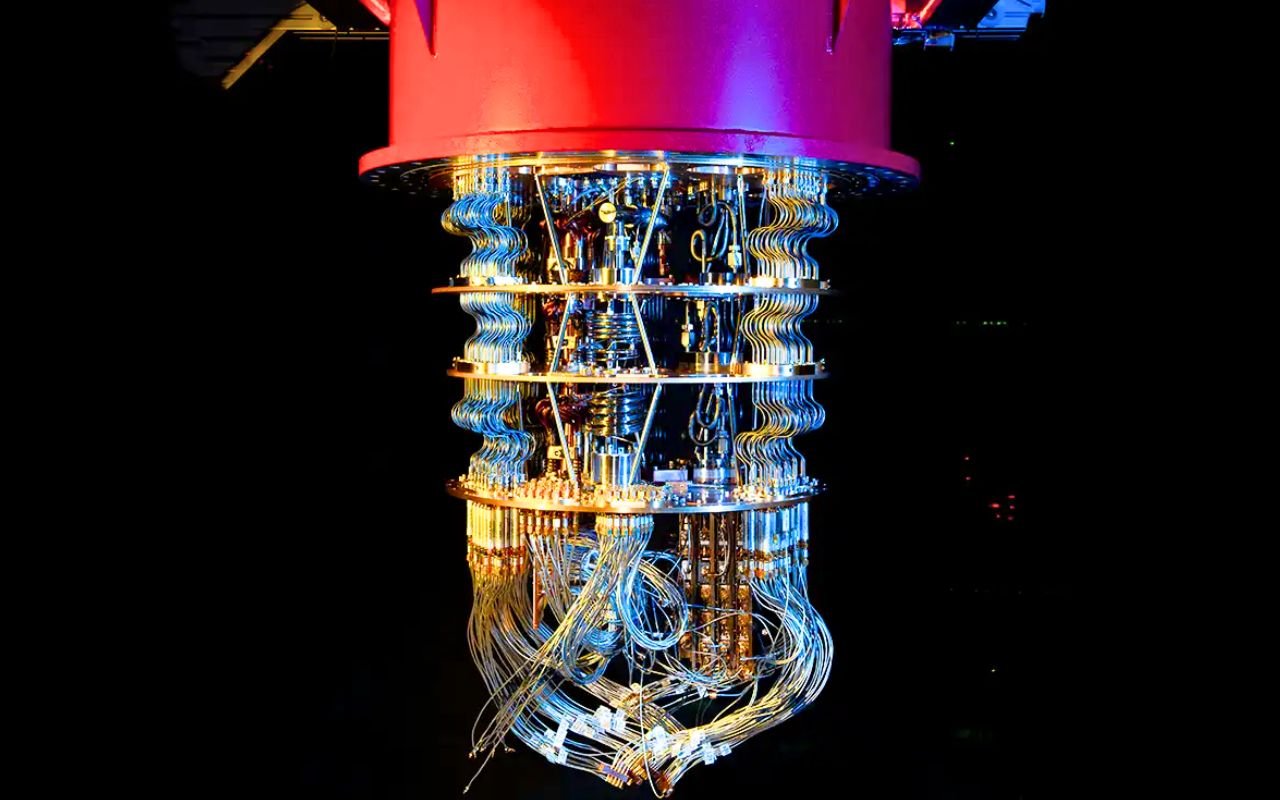

Le supercalculateur ABCI-Q mobilise 1 024 NVIDIA H100

Pour tenir cette montée en charge, l’équipe s’appuie sur le système ABCI-Q de l’institut japonais AIST, en utilisant jusqu’à 1 024 NVIDIA H100. Ce détail compte, parce que la simulation de circuits quantiques est dominée par des opérations d’algèbre linéaire et des transferts mémoire, un terrain où les GPU modernes excellent. Dans ce type de charge, la bande passante mémoire et la capacité à paralléliser finement font souvent la différence entre une démo et une exécution reproductible. Les chercheurs expliquent avoir travaillé sur les goulets d’étranglement classiques, avec une technologie de calcul parallèle visant à maximiser l’efficacité sur un grand cluster de GPU. Ils mentionnent aussi l’implémentation dans un simulateur dédié à la chimie quantique, chemqulacs-gpu. Concrètement, ce genre d’optimisation touche la répartition des données, la synchronisation entre nuds, et la manière dont on planifie les opérations, car un mauvais découpage peut faire perdre une fraction énorme des performances théoriques. On peut mettre ce résultat en perspective avec des annonces plus modestes mais révélatrices des contraintes matérielles. Par exemple, une démonstration sur GPU unique a mis en avant des simulations universelles jusqu’à 34 qubits sur une carte très dotée en mémoire. La comparaison n’est pas directe, car les circuits et objectifs diffèrent, mais elle rappelle une réalité, la mémoire reste le verrou numéro un. D’où l’intérêt d’un passage à l’échelle sur cluster, même si cela ajoute de la complexité réseau et logicielle.

La chimie quantique vise médicaments et matériaux, mais l’industrialisation reste lente

Le bénéfice immédiat, c’est le banc d’essai pour des algorithmes destinés aux futurs ordinateurs quantiques tolérants aux fautes. Les équipes peuvent étudier des systèmes moléculaires plus grands, tester la robustesse numérique, et comparer différentes stratégies de circuits. L’annonce insiste sur des applications industrielles comme la découverte de médicaments et le développement de nouveaux matériaux, deux domaines où les calculs d’énergie et d’états électroniques deviennent rapidement inabordables avec des méthodes classiques dès qu’on vise la précision. Le contexte est aussi celui d’une course aux méthodes de simulation. Des travaux académiques antérieurs décrivent des approches alternatives, par exemple des représentations compressées de l’état quantique ou des schémas hybrides pour réduire les coûts, parfois au prix d’hypothèses sur l’intrication ou la profondeur des circuits. Ici, la valeur de la simulation à grande échelle est de fournir un point de comparaison pour des circuits et des charges plus proches de ce qu’exigera un futur calcul quantique utile, sans se limiter à des cas volontairement simplifiés. Mais il faut garder la tête froide, industrialiser la chimie quantique via le calcul quantique reste un chantier long. Simuler sur 1 024 GPU prouve qu’on peut valider des briques, pas qu’un laboratoire pharmaceutique va remplacer ses pipelines demain matin. Marc, côté industrie, formule la critique la plus fréquente, tant qu’on ne relie pas ces benchmarks à des gains mesurables, coût, délai, précision, les directions R&D restent prudentes. En résultat, cette avancée sert surtout de socle technique, pour trier ce qui mérite d’être porté sur les futures machines quantiques tolérantes aux fautes.

À retenir

- Une simulation classique de circuits IQPE en chimie quantique a été réalisée jusqu’à 1 024 GPU.

- Le travail dépasse une limite précédemment rapportée autour de 40 qubits pour ce type de simulation.

- Le système ABCI-Q et des optimisations de parallélisation ont permis la montée en charge.

- L’objectif principal est le benchmark d’algorithmes pour de futurs ordinateurs quantiques tolérants aux fautes.

Questions fréquentes

- Qu’est-ce qui a été simulé exactement dans cette annonce ?

- Il s’agit d’une simulation classique de circuits d’estimation de phase quantique itérative (IQPE) appliqués à des problèmes de chimie quantique, afin de tester des algorithmes sur des tailles plus ambitieuses.

- Pourquoi l’usage de 1 024 GPU est-il déterminant ?

- La simulation de circuits quantiques exige beaucoup de mémoire et de calcul. Un cluster de 1 024 GPU permet de répartir la charge, de contourner des limites matérielles sur une seule machine et d’évaluer les performances en conditions de grande échelle.

- Est-ce une preuve qu’un ordinateur quantique est déjà dépassé ?

- Non. Une simulation classique sert surtout de banc d’essai. Elle aide à développer et valider des algorithmes en attendant des ordinateurs quantiques tolérants aux fautes, capables d’exécuter ces calculs de manière native.

- Quels secteurs sont visés par la chimie quantique à long terme ?

- Les travaux ciblent des applications industrielles comme la découverte de médicaments et le développement de matériaux, où des prédictions plus fines des propriétés moléculaires peuvent accélérer la R&D.

Sources

- World’s Largest Quantum Circuit Simulation For Quantum Chemistry …

- World’s largest quantum circuit simulation for quantum chemistry …

- The University of Osaka and Fixstars Corporation Demonstrate One …

- [PDF] Large-Scale Simulation of Quantum Computational Chemistry on a …

- Largest Single-GPU Quantum Simulation on AMD by BlueQubit