Le chiffre qui fait lever les sourcils dans les labos, c’est 10 000 qubits. Une équipe mêlant chercheurs de Caltech et de la start-up Oratomic affirme qu’un ordinateur quantique utile pourrait fonctionner avec seulement 10 000 à 20 000 qubits, alors que la barre était souvent placée à des millions.

L’idée n’est pas de promettre une machine miracle demain matin, mais de réduire drastiquement le volume de qubits nécessaires pour corriger les erreurs, le point faible des prototypes actuels. Dans leur travail, les scientifiques s’attaquent à un problème concret, faire tourner des algorithmes exigeants malgré le bruit et les pertes d’information. Ils citent notamment la faisabilité de l’algorithme de Shor, célèbre car il permet de factoriser des nombres et de casser certaines méthodes de chiffrement. Sur le papier, cette compression des besoins pourrait rapprocher l’industrialisation, avec une fenêtre évoquée d’ici la fin de la décennie, mais le passage du modèle à la machine reste un chantier lourd.

Caltech et Oratomic ramènent l’objectif à 10 000-20 000 qubits

Le cur de l’annonce tient en une comparaison simple, hier on parlait de millions de qubits, aujourd’hui l’équipe avance une cible de 10 000 à 20 000 qubits pour une machine pleinement opérationnelle. Cette baisse vient d’une approche de correction d’erreurs pensée pour limiter la redondance. Dans les architectures classiques, on empile des qubits physiques pour fabriquer des qubits logiques plus fiables, ce qui fait exploser les besoins matériels. Un exemple souvent cité dans les discussions sur le quantique, c’est l’ordre de grandeur, si une machine a besoin d’environ 1 000 qubits logiques et que chaque qubit logique coûte 1 000 qubits physiques, on grimpe à 1 million. Le raisonnement est brutal, mais il illustre la difficulté, fabriquer, contrôler et synchroniser autant d’unités fragiles. Ce que propose l’équipe, c’est une architecture qui réduit ce coût de fiabilité. La promesse est directe, moins de qubits à fabriquer, donc une trajectoire industrielle plus crédible. Mais il faut garder la tête froide, ce résultat est théorique et dépend d’hypothèses sur la qualité des qubits et la capacité à reconfigurer le système. Marc, ingénieur en calcul haute performance, résume le sentiment, c’est une bouffée d’air, mais tant qu’on n’a pas une machine qui tient des jours sans dériver, on reste dans la démonstration.

Une correction d’erreurs repensée pour limiter les qubits redondants

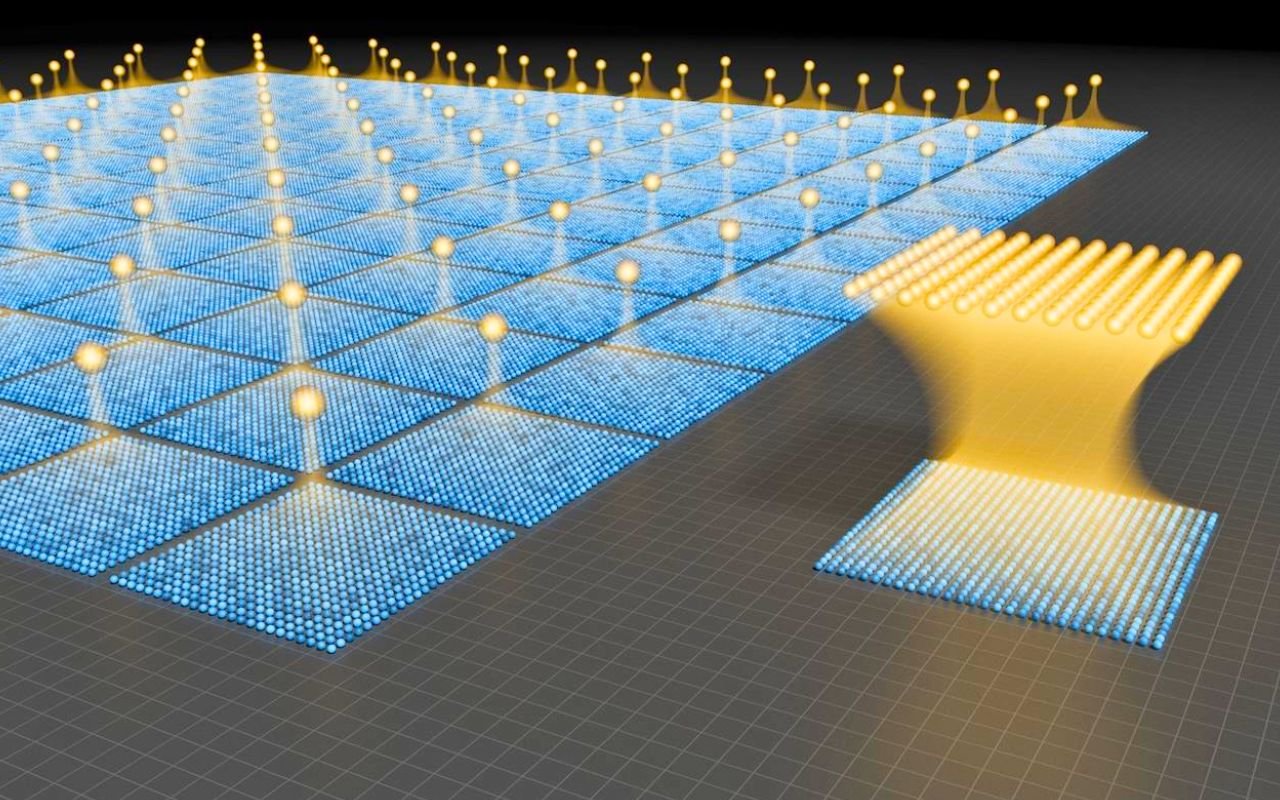

Le talon d’Achille des prototypes, ce sont les erreurs, décohérence, bruit, opérations imparfaites. La stratégie classique consiste à multiplier les qubits pour détecter et corriger, mais cette inflation rend la machine quasi ingérable à grande échelle. L’approche décrite par Caltech et Oratomic vise une correction d’erreurs plus économe, avec des qubits atomiques reconfigurables mis en avant dans leur démonstration. Pourquoi la reconfiguration compte, parce qu’un système capable de réorganiser ses qubits peut, en théorie, contourner des zones moins fiables, optimiser les interactions et réduire la redondance. Dit autrement, au lieu de construire une cathédrale de qubits pour compenser les défauts, on cherche une architecture qui tolère mieux les imperfections. Sur le papier, cela change la facture matérielle, mais aussi l’ingénierie, lasers, contrôle, calibration, stabilité thermique. La nuance importante, c’est que réduire le nombre ne supprime pas la difficulté. Piloter 10 000 qubits reste colossal, alimentation, synchronisation, électronique de contrôle, diagnostics. Et il y a un biais possible, une start-up comme Oratomic a intérêt à mettre en avant une trajectoire favorable. Ce n’est pas illégitime, mais cela impose une lecture prudente, la validation la plus convaincante viendra d’expériences reproductibles, pas d’un seul scénario optimisé.

Bitcoin, RSA-2048 et ECC-256 face à des scénarios d’attaque en jours

Le quantique devient concret quand on parle sécurité. D’après les estimations relayées autour de ce travail, casser l’ECC-256, utilisée pour sécuriser de nombreux portefeuilles de cryptomonnaies comme bitcoin et ether, pourrait être envisageable avec des machines de l’ordre de 26 000 qubits dans un scénario donné, avec un temps d’exécution évoqué autour de dix jours. C’est précisément le type de chiffre qui fait bouger les équipes de cybersécurité. Pour d’autres standards, l’échelle change, le RSA-2048 est associé à un besoin d’environ 102 000 qubits et à un délai de l’ordre de trois mois dans ces projections. Même si ces nombres restent théoriques, ils déplacent la discussion, on ne parle plus d’une menace lointaine à plusieurs décennies, mais d’une course de calendrier. Les migrations vers des solutions résistantes au quantique deviennent un sujet de gouvernance, pas un gadget de chercheurs. Un autre point marquant, ce recul des besoins en qubits s’inscrit dans une tendance longue, des estimations qui ont chuté de plusieurs ordres de grandeur en une vingtaine d’années. Mais la menace n’est pas uniforme, un acteur capable de financer une machine, de l’exploiter et de la maintenir reste rare. Marc, consultant en sécurité, tranche, le risque, ce n’est pas que tout casse demain, c’est que certains secrets à longue durée de vie soient déjà captés aujourd’hui pour être déchiffrés plus tard.

À retenir

- Caltech et Oratomic estiment une machine utile possible avec 10 000 à 20 000 qubits.

- La baisse vient d’une architecture de correction d’erreurs visant moins de redondance.

- Des projections évoquent des impacts sur ECC-256 et RSA-2048, avec des délais en jours ou mois.

- Le passage de la théorie à une machine stable reste la principale barrière technique.

Questions fréquentes

- Pourquoi parlait-on auparavant de millions de qubits ?

- Parce que les qubits sont très sensibles au bruit et aux erreurs. Les approches classiques de correction d’erreurs exigent beaucoup de qubits physiques pour obtenir un petit nombre de qubits logiques fiables, ce qui fait rapidement monter les besoins à l’échelle du million.

- Que signifie « ordinateur quantique utile » dans ce contexte ?

- Il s’agit d’une machine capable d’exécuter des calculs pertinents malgré les erreurs, notamment des algorithmes exigeants comme l’algorithme de Shor. L’objectif n’est pas un prototype de démonstration, mais une capacité de calcul soutenue et exploitable.

- Est-ce que 10 000 qubits suffisent pour casser le chiffrement moderne ?

- Les estimations associées à ces travaux évoquent des ordres de grandeur variables selon les cibles. Pour l’ECC-256, un scénario mentionne autour de 26 000 qubits et environ dix jours, tandis que le RSA-2048 serait plutôt associé à environ 102 000 qubits et plusieurs mois. Cela reste théorique et dépend de la qualité des qubits et de l’architecture.

- Peut-on vraiment avoir ces machines avant 2030 ?

- L’équipe avance qu’avec moins de qubits requis, des machines opérationnelles pourraient, en théorie, arriver d’ici la fin de la décennie. Mais la construction, le contrôle et la stabilité d’un système à 10 000 qubits restent des défis d’ingénierie majeurs.

Sources

- Caltech Team Finds Useful Quantum Computers Could … – HPCwire

- Caltech Team Finds Useful Quantum Computers Could Be Built with …

- From The California Institute of Technology: “Caltech Team Finds …

- Quantum breakthrough cuts 1,000 qubits to five, speeds computing

- A quantum computer may need just 10,000 qubits to … – CoinDesk