Le supercalculateur JUPITER, installé au Jülich Supercomputing Centre en Allemagne, vient de franchir un cap symbolique, la simulation complète d’un ordinateur quantique universel de 50 qubits.

Le précédent record s’arrêtait à 48 qubits, une limite déjà atteinte par la même équipe lors d’un jalon antérieur. Dans le monde du calcul, deux qubits de plus, ce n’est pas “un petit progrès”, c’est une marche exponentielle. La démonstration ne dit pas que les machines quantiques sont dépassées, elle rappelle plutôt une réalité, simuler le quantique reste un outil central pour concevoir des algorithmes, vérifier des résultats et préparer les usages. La performance repose sur une combinaison très concrète, une architecture mémoire capable d’absorber des volumes gigantesques et un logiciel de simulation optimisé pour exploiter cette mémoire sans s’effondrer en cours de route.

Jülich dépasse le seuil des 50 qubits

Le record tient à un point précis, la simulation “complète” d’un calcul quantique universel, pas une approximation, pas un cas jouet. À 50 qubits, l’état quantique à représenter explose, chaque qubit ajouté double les besoins, ce qui transforme la progression en mur. Les équipes de Jülich ont déjà signé le précédent jalon à 48 qubits, et elles démontrent ici que la barrière n’était pas théorique, mais d’infrastructure.

Pour donner un ordre de grandeur, simuler 50 qubits demande environ 2 pétaoctets de mémoire, soit près de deux millions de gigaoctets. Sur un ordinateur portable, on reste autour de quelques dizaines de qubits, typiquement 30 qubits selon les ingénieurs, au-delà les ressources manquent. Prof. Kristel Michielsen, directrice au Jülich Supercomputing Centre, insiste sur le lien direct entre progrès du calcul haute performance et recherche quantique.

Ce type de simulation sert de banc d’essai avant que des processeurs quantiques suffisamment fiables soient largement disponibles. Des approches comme le VQE pour la modélisation moléculaire ou le QAOA pour l’optimisation peuvent être évaluées, comparées, stress-testées. Mais il faut garder une nuance, une simulation parfaite ne remplace pas le comportement d’un matériel réel soumis au bruit, elle aide surtout à préparer, calibrer et comprendre.

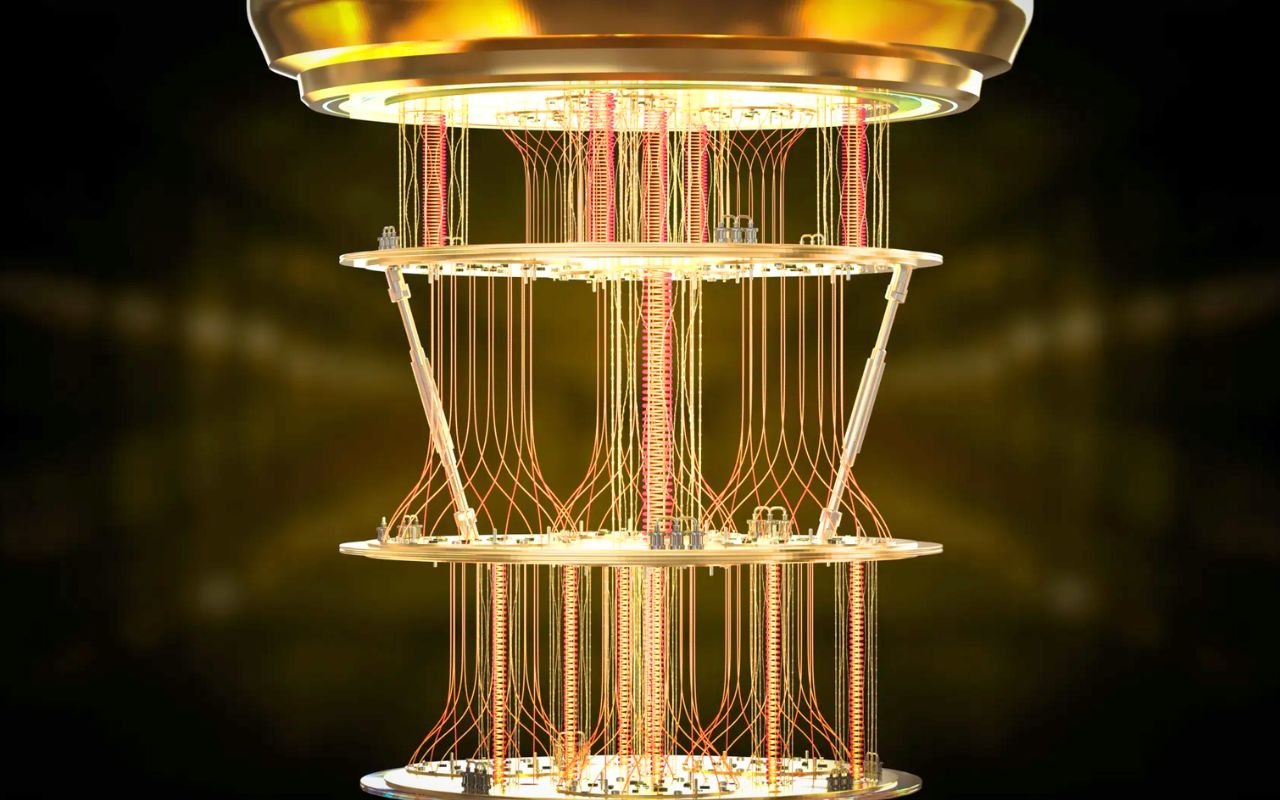

JUQCS-50 et les NVIDIA GH200 au cur du saut

La performance ne vient pas seulement du “gros fer”. Le logiciel JUQCS-50, évolution du Jülich Universal Quantum Computer Simulator, a été adapté pour exploiter une architecture mémoire hybride. Le point clé, les NVIDIA GH200 couplent étroitement CPU et GPU, ce qui permet de déporter temporairement des données au-delà de la mémoire GPU vers la mémoire CPU, avec une perte de performance limitée.

Le défi est mathématique et logistique. À chaque opération quantique, l’algorithme doit mettre à jour plus de 2 quadrillions de valeurs numériques complexes, un “2” suivi de 15 zéros, puis synchroniser ces données sur des milliers de nuds. Si la circulation de données sature, tout s’écroule. Les spécialistes ont donc travaillé sur les transferts, l’ordonnancement et l’efficacité, pour que la simulation reste stable à cette échelle.

Dans les communiqués techniques, les équipes mentionnent aussi une compression par encodage d’octets, présentée comme un gain d’un facteur 8, et une optimisation dynamique des échanges sur plus de 16 000 superchips. Prof. Hans De Raedt, cité comme auteur principal, met en avant une émulation “à haute fidélité”. Là encore, prudence, la fidélité dépend du modèle et des hypothèses, mais l’infrastructure ouvre un terrain d’expérimentation rarement accessible.

Pourquoi ce record pèse sur l’IA, le climat et le quantique

Le message politique et industriel est clair, l’exascale européen n’est pas seulement un trophée. JUPITER est annoncé comme capable d’atteindre l’ordre de l’exascale, soit un quintillion d’opérations FP64 par seconde, et il cible des usages transversaux, simulation, entraînement et inférence de grands modèles d’IA, climat, biologie structurale, ingénierie, astrophysique. Le quantique s’insère dans cette liste comme un domaine où l’on a besoin d’outils de validation.

Un autre indicateur est mis en avant, l’efficacité énergétique. JUPITER est présenté comme le plus efficace parmi les cinq premiers systèmes du classement TOP500, à environ 60 gigaflops par watt. Dans un contexte où l’électricité devient une contrainte stratégique, ce type de ratio compte presque autant que la vitesse brute. Mais il faut aussi le dire, simuler 50 qubits mobilise des ressources gigantesques, ce n’est pas un outil “du quotidien”.

Pour la recherche quantique, l’intérêt est immédiat, tester des circuits, comparer des stratégies, vérifier des résultats expérimentaux avant de réserver du temps sur des machines quantiques rares. Pour l’industrie, le bénéfice est plus indirect, les algorithmes d’optimisation comme QAOA intéressent la logistique ou la finance, mais on parle encore de préparation. L’avancée montre surtout que le calcul classique a encore des marges, à condition d’investir dans les architectures mémoire et les logiciels.

À retenir

- JUPITER a simulé un ordinateur quantique universel de 50 qubits, au-delà du record de 48.

- La simulation exige environ 2 pétaoctets de mémoire et une synchronisation massive des données.

- JUQCS-50 exploite une mémoire hybride CPU-GPU via les superchips NVIDIA GH200.

- Le record illustre le rôle des supercalculateurs exascale pour tester des algorithmes quantiques comme VQE et QAOA.

Sources

- JUPITER supercomputer breaks world record with 50-qubit quantum simulation | ScienceDaily

- New Record on JUPITER: Simulating a 50-Qubit Quantum Computer

- JUPITER supercomputer nails full 50-qubit quantum simulation record

- HPCwire – Since 1987 – Covering the Fastest Computers in the World and the People Who Run Them

- NVIDIA Powers Europe’s Fastest Supercomputer | NVIDIA Newsroom